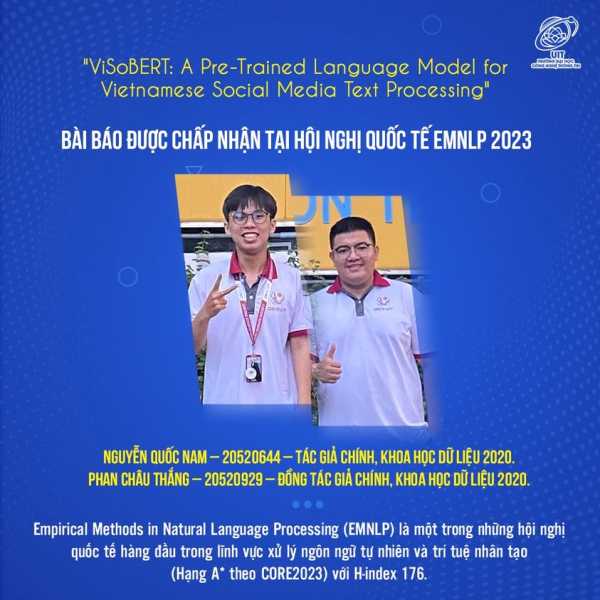

Bài báo: “ViSoBERT: A Pre-Trained Language Model for Vietnamese Social Media Text Processing”

Link bài báo (preprint): https://arxiv.org/abs/2310.11166

Pre-trained LM Code: https://huggingface.co/uitnlp/visobert

Sinh viên thực hiện:

Nguyễn Quốc Nam – 20520644 – Tác giả chính, Khoa học dữ liệu 2020.

Phan Châu Thắng – 20520929 – Đồng tác giả chính, Khoa học dữ liệu 2020

Giảng viên hướng dẫn

ThS. Nguyễn Văn Kiệt

ThS. Nguyễn Đức Vũ

Tóm tắt bài báo:

Tiếng Anh và tiếng Trung, được biết đến là các ngôn ngữ giàu tài nguyên, đã có sự phát triển mạnh mẽ của các mô hình ngôn ngữ cho các tác vụ xử lý ngôn ngữ tự nhiên. Tiếng Việt hiện là ngôn ngữ thứ tám được sử dụng trên Internet, với khoảng 85 triệu người dùng trên khắp thế giới. Mặc dù có sẵn một lượng lớn dữ liệu tiếng Việt trên Internet, sự phát triển trong nghiên cứu xử lý ngôn ngữ tự nhiên (NLP) tiếng Việt vẫn còn hạn chế. Một số mô hình như PhoBERT, ViBERT và vELECTRA đã được đề xuất và hoạt động tốt trên các tác vụ xử lý ngôn ngữ tự nhiên tiếng Việt tổng quát, bao gồm POS tagging và Named Entity Recognition. Tuy nhiên, những mô hình ngôn ngữ này vẫn có hạn chế trong các tác vụ về mặt xử lý ngôn ngữ và phân tích dữ liệu truyền thông xã hội của tiếng Việt. Do đó, trong bài báo này, chúng tôi đề xuất mô hình ngôn ngữ đầu tiên cho văn bản trên mạng xã hội tiếng Việt, gọi là ViSoBERT, được tiền huấn luyện trên một tập dữ liệu lớn, chất lượng cao và đa dạng về văn bản trên mạng xã hội tiếng Việt dựa trên kiến trúc của mô hình XLM-R. Hơn nữa, chúng tôi đã đánh giá mô hình của chúng tôi trên 5 tác vụ quan trọng về xử lý ngôn ngữ tự nhiên trên văn bản trên mạng xã hội tiếng Việt: emotion recognition, hate speech detection, sentiment analysis, spam reviews detection, và hate speech spans detection. Để hiểu sâu về mô hình ngôn ngữ của chúng tôi, nhóm đã phân tích kết quả thực nghiệm về Masking Rate, xem xét các đặc điểm của mạng xã hội bao gồm Icons, Teencodes và Dấu câu, và triển khai trích xuất dựa trên đặc trưng cho các mô hình cụ thể ngôn ngữ. Các thử nghiệm của chúng tôi chứng minh rằng ViSoBERT, với ít tham số hơn, vượt qua các mô hình tiên tiến trước đây trên nhiều tác vụ của văn bản mạng xã hội tiếng Việt.

Chúng em muốn bày tỏ lòng biết ơn sâu sắc đến Thầy Nguyễn Văn Kiệt - Phó Trưởng Khoa Khoa học và Kỹ thuật thông tin và Thầy Nguyễn Đức Vũ vì đã dành thời gian và tâm huyết để hướng dẫn và chỉ ra những hạn chế trong quá trình nghiên cứu và công bố bài báo khoa học quốc tế này.

: Empirical Methods in Natural Language Processing (EMNLP) là một trong những hội nghị quốc tế hàng đầu trong lĩnh vực xử lý ngôn ngữ tự nhiên và trí tuệ nhân tạo (Hạng A* theo CORE2023) với H-index 176.

Thông tin chi tiết: https://www.facebook.com/UIT.Fanpage/posts/pfbid0bikaeBJkqHcD8Yc1h2ifxXrKr3BQERgLuswK5c2Y8qULCBMMep3EkGQNkkzh7ExYl

Hải Băng - Cộng tác viên Truyền thông trường Đại học Công nghệ Thông tin